Il n’y a rien de faux à ce sujet. L’industrie juridique est confrontée à un gros problème avec DeepFakes. Les salles d’audience ne sont pas encore inondées d’un tsunami de preuves profondes, mais avec cette technologie générée par l’intelligence artificielle jouant avec un grand succès sur les réseaux sociaux et dans les programmes de fraude, ce n’est qu’une question de temps avant que Deepfakes ne tombe régulièrement dans la liste des expositions.

Les cas avec un composant DeepFake comprennent déjà:

États-Unis c. Reffitt: L’avocat d’un défendeur a fait valoir que la preuve de l’accusation pourrait être unfake profond. SZ Huang V Tesla: L’avocat d’un défendeur a fait valoir que les preuves vidéo des déclarations d’un parti pourraient être unfake profond. États-Unis c. Doolin: Un tribunal a autorisé l’introduction de preuves vidéo que la défense a fait valoir aurait pu être unfake profond. Al-Qarqani c. Chevron Corp.: Un avocat a soumis une exposition récitant un calendrier prétendument faux de faits publié dans un journal qui n’existe pas.

Selon l’article de mars 2023, le New York Times, de nombreuses applications et outils utilisés pour créer DeepFakes sont disponibles pour toute personne disposant d’un smartphone et sont gratuites ou peu coûteuses, ce qui rend beaucoup trop facile de créer ou de modifier des preuves numériques.

L’amplification du problème est le fait que «en ce moment, la vérité commence à devenir un diplôme», explique Maura R. Grossman, professeur de recherche à l’Université de Waterloo et avocat et maître spécial de découverte électronique. Grossman pointe vers des exemples, tels que de toucher une photo d’exposition pour transformer un froncement de sourcils en un sourire. Ce petit changement peut être immatériel pour un cas – ou pas.

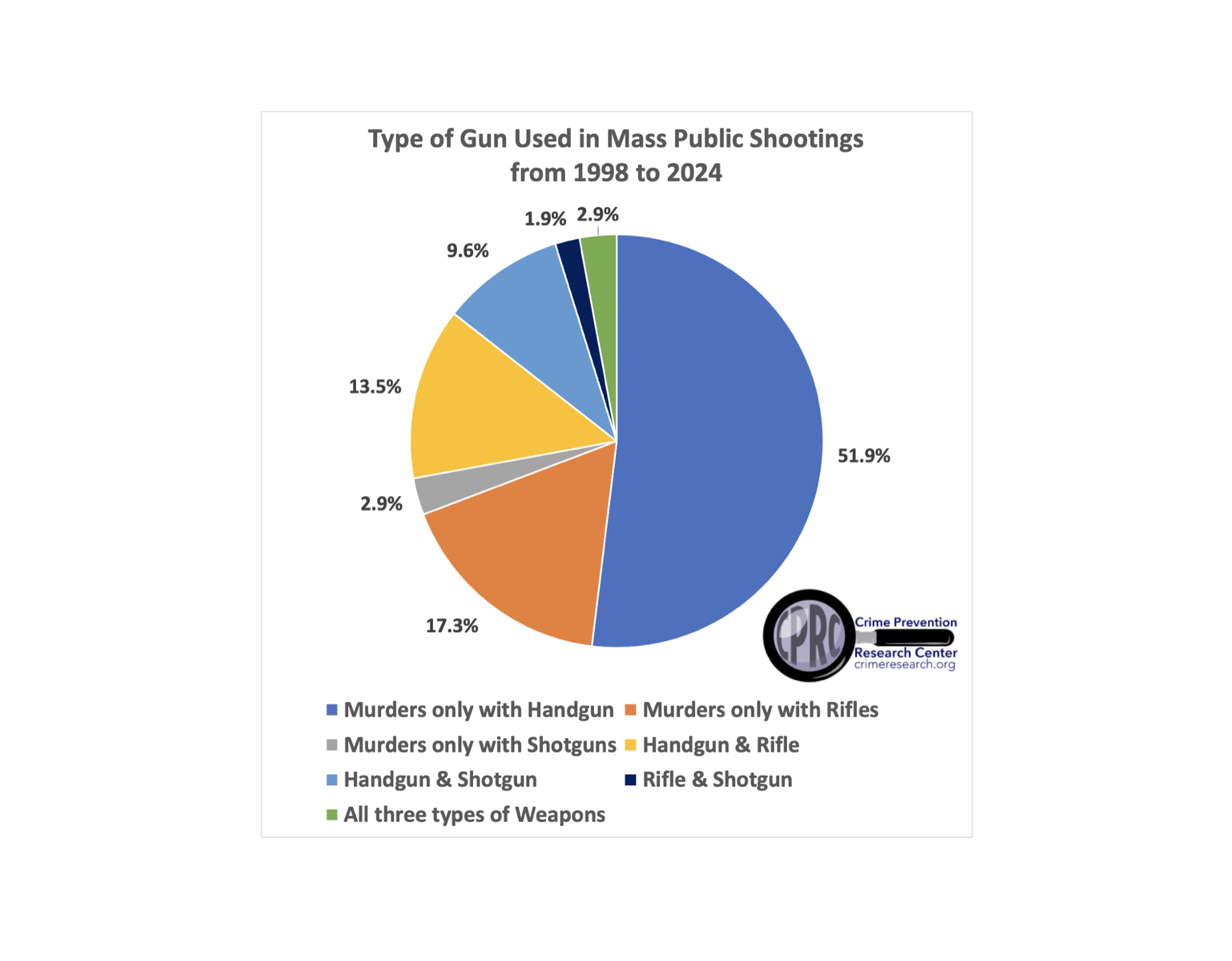

Qu’en est-il de changer quelques pixels pour rendre impossible de dire si quelqu’un tient un téléphone ou un pistolet à la main? Des preuves photo et vidéo matériellement modifiées seront jetées, mais une désinformation basée sur la réalité reconfigurée sera sans aucun doute introduite dans la salle d’audience et aux jurys.

«Une grande partie du système judiciaire repose sur l’interprétation des preuves et la décision du poids à lui donner», explique Grossman. “Et nous entrons maintenant dans un monde où non seulement nous ne pouvons plus compter sur nos sens pour ce faire, mais nous pouvons avoir besoin d’experts, et qui change le coût. Et pour le juge, cela crée des retards et ajoute une toute nouvelle couche.”

La solution la plus efficace est-elle une solution technique ou juridique?

Le monde juridique est aux prises avec la façon de gérer les preuves DeepFake, les solutions procédurales attirant actuellement l’attention du public à mesure que les solutions technologiques se développent plus lentement. Voici trois approches sur la façon dont les preuves suspectées d’être Deepfake peuvent être gérées dans le système juridique.

1. Experts techniques

Les experts médico-légaux numériques utilisent des capacités d’apprentissage automatique dans les systèmes de détection basés sur l’IA pour inspecter l’authenticité des médias numériques. Les vidéos DeepFake avec audio sont les plus difficiles à identifier en raison de la tendance humaine à ignorer les petites divergences dans une vidéo et à se concentrer sur l’idée principale.

Les experts médico-légaux numériques peuvent appliquer une analyse multimodale pour examiner plusieurs sources de données et combiner des techniques. Ces capacités vont de la détection des artefacts à l’analyse par trame par trame et à l’analyse des clignotements à l’analyse du gradient de luminance et à l’analyse des erreurs de pixels. Après avoir effectué les analyses nécessaires, l’expert peut rendre une opinion quant à savoir si les preuves sont authentiques ou modifiées – ou non – fondées sur les irrégularités trouvées.

L’embauche d’un expert médico-légal numérique peut coûter de quelques centaines de dollars pour le conseil horaire à plusieurs milliers de dollars par projet. Pour les cas de haut niveau avec des implications juridiques importantes, les frais peuvent être beaucoup plus importants.

Jerry Bui de Right Forensics, basé au Texas, est également consultant d’Interpol. Il nous dit que «Deepfakes nous oblige à affronter une vérité inconfortable: voir ne croit plus. En tant qu’experts médico-légaux, nous n’authentifions pas seulement les preuves – nous essayons de protéger l’intégrité du système judiciaire à une époque où la manipulation numérique peut réécrire la réalité.»

Chuck Kellner est un conseiller stratégique de découverte chez Everlaw.

2. Règles judiciaires

Les tribunaux américains se déplacent lentement pour répondre aux preuves DeepFake. Au 8 novembre 2024, réunion du comité consultatif des règles de preuve, un comité de la Conférence judiciaire des États-Unis, le comité a examiné la règle 901 (c) proposée par Grossman et le juge Paumm, juge fédéral à la retraite et professeur à la Duke University School of Law.

La règle, si elle était adoptée, régirait les «preuves électroniques potentiellement fabriquées ou modifiées», lecture: «Si un parti contestant l’authenticité des preuves générées par ordinateur ou d’autres éléments électroniques démontre au tribunal qu’un jury pourrait raisonnablement constater que la preuve a été modifiée ou fabriquée, en tout preuve.”

La règle proposée de Grimm et Grossman place les charges aux défis et aux parties de l’offre, ainsi que sur les tribunaux, contribuant à réduire le risque d’exposer les jurys à DeepFakes. Il est l’un des nombreux étant considérés par divers comités judiciaires. Certains experts pensent qu’aucun changement n’est nécessaire aux règles de preuve.

Étant donné la vitesse à laquelle la technologie DeepFake évolue et s’améliore, les changements dans les règles ou les procédures peuvent ne pas être utiles. Dans l’intervalle, les décisions seront prises par les tribunaux sur la base de défis individuels au fur et à mesure.

3. Approches procédurales

Les tribunaux utiliseront les règles existantes pour prendre des décisions dans un avenir prévisible, ayant des audiences sur des preuves. Les juges devront accepter d’analyser les preuves numériques, mettant le fardeau aux justiciables pour prouver la légitimité des preuves en question, plutôt que de placer le fardeau sur le juge pour décider si les preuves sont authentiques ou profondes, admissibles ou non.

L’une des questions critiques qui se pose lorsque l’on considère l’impact juridique des Facked est le coût – qui paie pour prouver si les preuves sont réelles ou fausses?

«Cela devient un problème d’accès à la justice», explique Rebecca Delfino, doyenne associée des programmes cliniques et de l’apprentissage expérientiel à la Loyola Law School de l’Université Loyola Marymount. «Dans un monde parfait, il serait pris en charge dans une affaire pénale. Si le gouvernement veut prouver une image audiovisuelle, le défendeur a volé une banque, et que le défendeur prétend qu’il s’agit d’unfake profond, le gouvernement devrait avoir à payer pour une analyse d’experts parce que la charge de la preuve est sur les poursuites.

“Mais dans le contexte civil, ce sera un problème important”, poursuit Delfino. “Même pour un exemple simple – comme l’expression d’une photographie modifiée numériquement d’un froncement de sourcils à un sourire – l’individu devra conserver un certain type d’expert.”

Dans le tribunal de la famille, avec ses nombreux justiciables pro se, une autre réalité existe encore – qu’une photo montrant des ecchymoses changerait la vie de quelqu’un. Est-ce réel ou unfake Deep? Qui paie l’expert pour l’analyser?

Ce n’est qu’une multitude de questions à laquelle il reste à répondre sur la façon dont le monde juridique s’adaptera à une vague croissante de preuves profondes. Nous ne sommes peut-être pas à la fin de la réalité, mais Deepfakes va certainement faire vibrer le monde juridique tel que nous le connaissons.

Conseils de pratique

Recherchez des éléments de preuve trop bons ou trop dommages pour être vrais. Deepfakes dans les médias sociaux a tendance à être une vidéo, un audio et des images. Vous pouvez facilement obtenir une reconnaissance automatisée de caractères optiques pour trouver du texte en images. Vous pouvez également obtenir une transcription machine de l’audio et de la vidéo. Chacun de ceux-ci donne du texte consultable que vous pouvez utiliser comme point de départ pour découvrir du matériel suspect. Planifiez votre dépôt ou votre essai, afin que vous ayez vos listes d’expositions prêtes plus tôt que vous. Implore le tribunal pour exiger que vos adversaires fassent de même. Évaluez les expositions, en accordant une attention particulière à ceux qui ont des formats audio, vidéo ou image. Interrogez vos témoins et contestez le contenu suspect. N’attendez pas le jour du témoignage. Soyez prêt à engager un examinateur médico-légal informatique pour évaluer la qualité de preuve d’un article soupçonné de Deepfake.

Voir aussi:

Le système juridique est-il prêt pour les vidéos DeepFake générées par l’AI-AI?

Chuck Kellner est un conseiller stratégique de découverte chez Everlaw. Kellner a travaillé comme expert sur les protocoles de découverte électronique, la proportionnalité et le coût de la découverte électronique, les résultats de l’examen médico-légal informatique et les exigences pour la recherche et l’examen défendables.

Mind Your Business est une série de colonnes rédigées par des avocats, des professionnels du droit et d’autres membres de l’industrie juridique. Le but de ces colonnes est d’offrir des conseils pratiques aux avocats sur la façon d’exécuter leurs pratiques, de fournir des informations sur les dernières tendances de la technologie juridique et comment les avocats peuvent aider les avocats à travailler plus efficacement et les stratégies pour créer une entreprise prospère.

Intéressé à contribuer une colonne? Envoyer une requête à [email protected].

Cette chronique reflète les opinions de l’auteur et pas nécessairement les vues de l’ABA Journal – ou de l’American Bar Association.